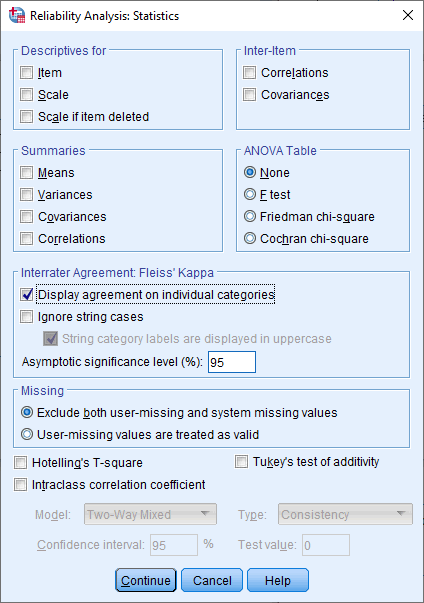

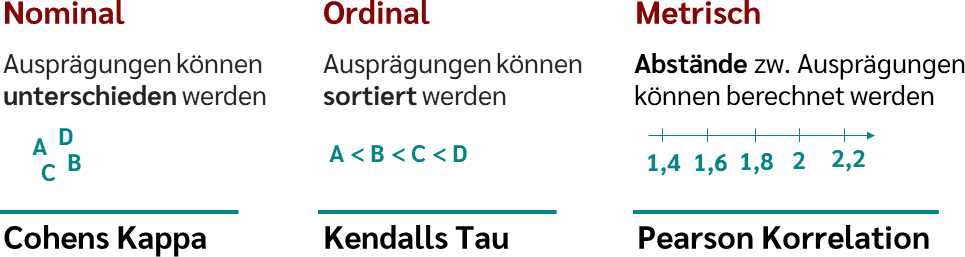

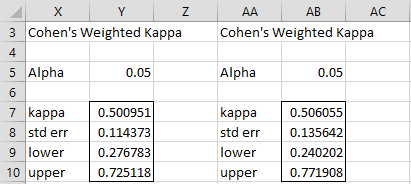

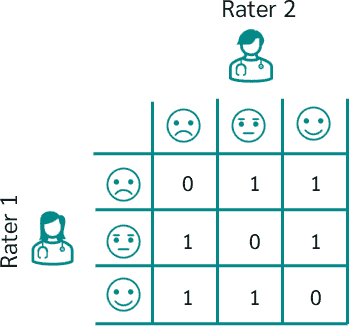

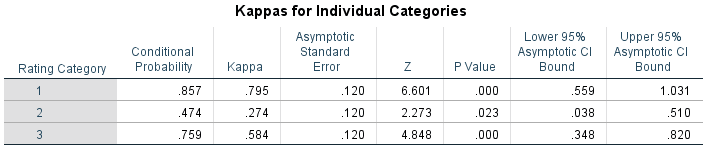

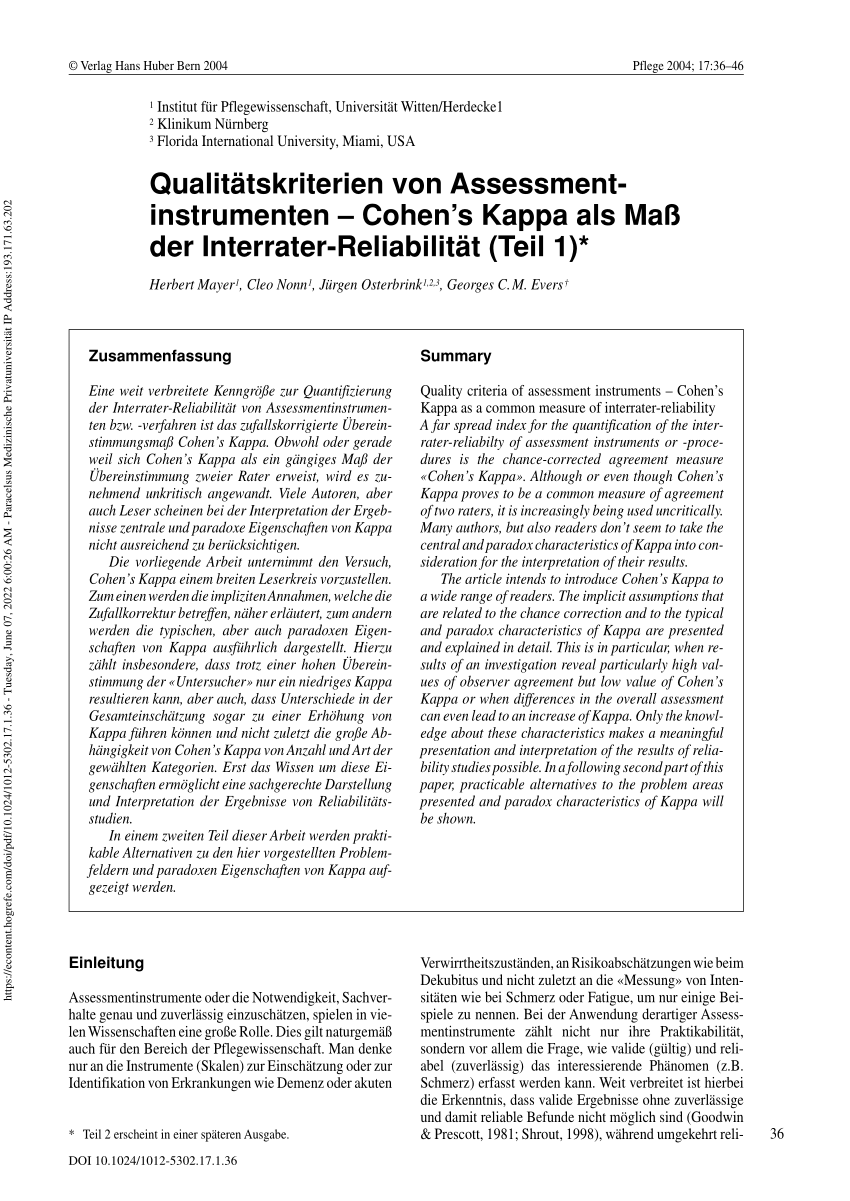

PDF) Qualitätskriterien von Assessmentinstrumenten – Cohen's Kappa als Maß der Interrater-Reliabilität (Teil 1)

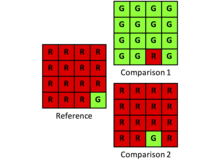

Cohen's Kappa, Positive and Negative Agreement percentage between AT... | Download Scientific Diagram

PDF) Qualitätskriterien von Assessmentinstrumenten – Cohen's Kappa als Maß der Interrater-Reliabilität (Teil 1)